Etwas komplizierter war und ist die Analyse von Deepfake-Videos. Hierbei experimentierte ich mit verschiedenen Ansätzen, wie Fraktalanalysen und der interessante Analyseweg ist die Prüfung auf der Pixelebene.

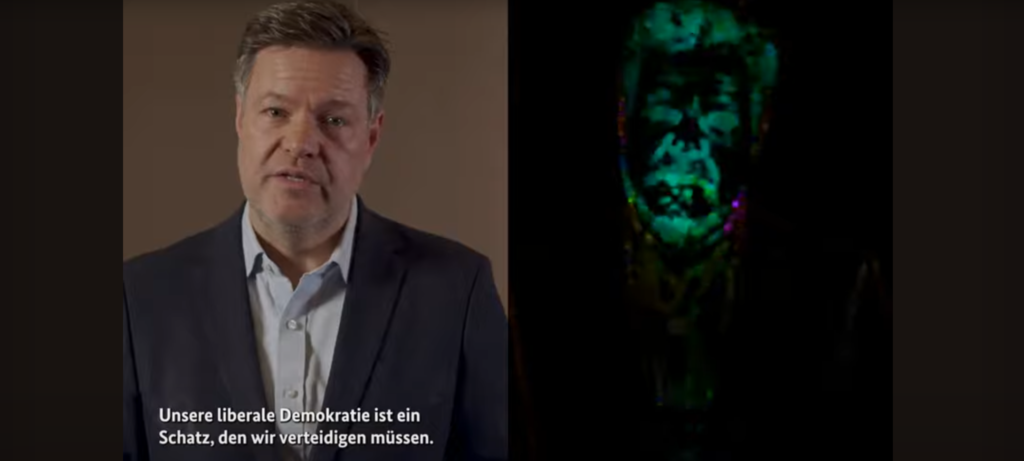

Beispiele „Deepfakes“

Beispiel „Kein Deepfake“

Die Analyseidee kam mir nach der Sichtung extrem vieler Video-Deepfakes. Hier fand ich bei personengebundenen Werken 2 Auffälligkeiten: (1) ein Austausch des Gesichtes und (2) ein Austausch der Mund- und Lippenareale.

In extrem vielen Fällen sind die Resultate sehr schlecht und relativ zügig erkennbar, in wenigen Fällen war die „manuelle“ Erkennung durchaus etwas komplizierter. Jedoch ist mir aufgefallen, dass die manipulierten Areale leicht „wackeln“ und hinsichtlich der Bewegungsabläufe leicht oder sehr stark unlogisch sein können.

Der Weg der Pixelanalyse kann Manipulationen visualisieren und hier fallen einige spannende Sachen auf: Deepfakes produzieren „matschige Areale“, die Gesichtskonturen verschwimmen und das liegt daran, dass bei den analysierten Proben die manipulierten Areale sich nicht im Kontext zum Gesamtwerk „bewegen“.